Новости

Все больше людей используют дипфейки для прохождения собеседований

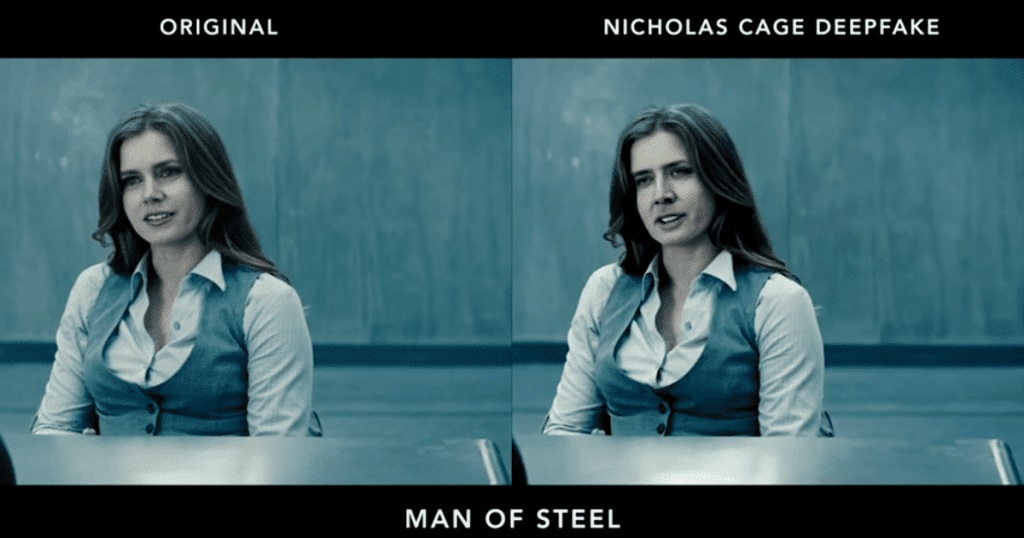

Технологии защиты от дипфейков, между тем, далеки от совершенства.

ФБР заявило вчера, что все больше и больше людей используют технологию дипфейков, чтобы изображать из себя кого-то другого на собеседовании.

В своем публичном заявлении Бюро рассказало, что получило всплеск жалоб на людей, накладывающих видео, изображения или аудио другого человека на себя во время собеседований в режиме реального времени. Жалобы были связаны с удаленными техническими ролями, которые предоставили бы успешным кандидатам доступ к конфиденциальным данным — «личной информации клиентов, финансовым данным, корпоративным базам данных и/или конфиденциальной информации».

«Использование этой технологии для преследования или причинения вреда частным лицам, которые не привлекают внимания общественности и не могут распоряжаться ресурсами, необходимыми для опровержения лжи, должно вызывать обеспокоенность», — предупреждало Министерство внутренней безопасности в отчете о технологии дипфейков еще в 2019 году.

Поддельные соискатели на технические должности не являются чем-то новым. В сообщении LinkedIn от ноября 2020 года один рекрутер написал, что некоторые кандидаты нанимают внешнюю помощь, чтобы помочь им во время интервью в режиме реального времени, и что эта тенденция, похоже, ухудшилась во время пандемии. В мае рекрутеры обнаружили, что северокорейские мошенники выдавали себя за американских кандидатов на работу в криптовалютные и Web3-стартапы.

Технологии защиты от дипфейков, между тем, далеки от совершенства. Согласно отчету Sentinel, в 2020 году количество известных онлайн-видео дипфейков достигло 145 227, что в девять раз больше, чем годом ранее. Отчет Sensity, компании по анализу угроз, показал, что в 86% случаев технологии защиты от дипфейков принимали видео с дипфейками за настоящие.

Тем не менее, есть некоторые явные признаки дипфейков, в том числе ненормальное моргание, неестественно мягкий фокус вокруг кожи или волос и необычное освещение.

В своем заявлении ФБР также предложило совет по обнаружению технологии голосового дипфейка. «В этих интервью действия и движения губ человека, у которого берут интервью на камеру, не полностью согласуются со звуком говорящего человека. Иногда такие действия, как кашель, чихание или другие слуховые действия, не соответствуют тому, что представлено визуально», — написало агентство.

-

Видео и подкасты для разработчиков3 недели назад

Видео и подкасты для разработчиков3 недели назадОт личной продуктивности к командной: сила шаблонизации в IDE

-

Новости3 недели назад

Новости3 недели назадВидео и подкасты о мобильной разработке 2026.20

-

Новости2 недели назад

Новости2 недели назадВидео и подкасты о мобильной разработке 2026.21

-

Разработка3 недели назад

Разработка3 недели назадГорячая перезагрузка AGSL-шейдеров без пересборки: пошаговое руководство для Compose